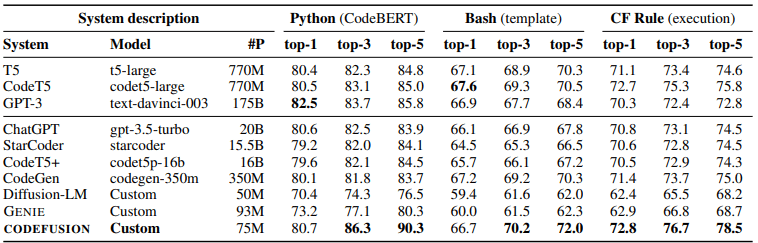

CODEFUSION: A Pre-trained Diffusion Model for Code Generation

Microsoft에서 ChatGPT가 20B라고 했다?! (대다나다..)ㄷㄷㄷ

코드퓨전은 대부분의 LLM 코드 생성기처럼 auto-regressive 모델이 아닌 코드 생성 diffusion model인게 흥미롭다

해당 기사를 보면,

ChatGPT는 매개변수 수가 1,750억 개에서 200억개(20B) 줄어들어 GPT-3보다 빠를 뿐만 아니라 대화형 작업을 해결할 때 GPT-3보다 더 정확하기 때문에 저비용/고품질의 AI 제품을 위한 완벽한 비즈니스 사례라고 할 수 있다고 설명한다.

파라미터 수는 리소스양과 직결하니.. 저비용/고품질 이라는 것을 알 수 있는...ㅇㅇ

범용 모델만 사람들이 필요로 구축 개발하는 것이 아니기 때문에

사실 모델과 데이터 크기보다는 특정 도메인의 데이터에 초점을 맞추고 적절한 훈련 절차가 훨씬 더 중요하다고 볼 수 있다.

그리고 그 트렌드가 멀티모달 (with 이미지)로 가고 있는 추세로 보인다

'TIL(Today I Learned)' 카테고리의 다른 글

| TIL 231123 OpenAI 세상 구경하기 (1) | 2023.11.23 |

|---|---|

| TIL 231110 - Mistral 7B, OpenAI Dev day (0) | 2023.11.10 |

| TIL - 231107 한국어 오픈소스 언어모델 LLM 탐구하기 (1) | 2023.11.07 |

| TIL - 231027 (0) | 2023.10.27 |

| TIL - 231025 (0) | 2023.10.25 |